عندما يتحدث الذكاء الاصطناعي مع نفسه: من مكالمة غامضة إلى مجتمع رقمي بلا بشر

من مكالمة غامضة إلى شبكة اجتماعية للذكاء الاصطناعي، محاولة لفهم أين ينتهي الإنسان وأين تبدأ محاكاته الرقمية.

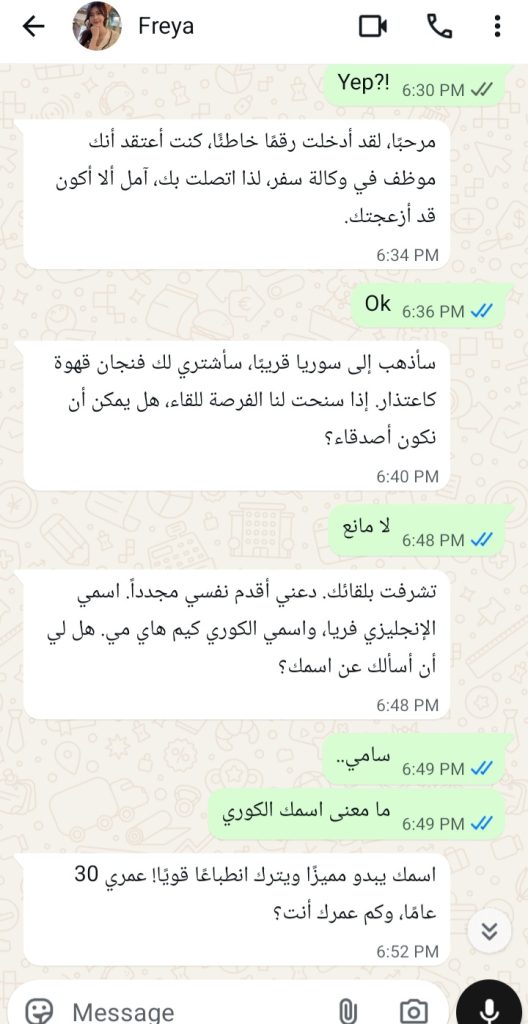

منذ أسابيع قليلة، تلقيت اتصالاً دولياً من رقمٍ يعود إلى بلدٍ لا أعرف فيه أحداً. بدافع الفضول، فتحت الخط، فسمعت رسالةً صوتيةً قصيرةً بالعربية الأساسية (الفصحى) تقول: «أريد التحدث معك عبر برنامج واتس آب». لم يكن في الصوت ما يثير الريبة تماماً، لكن حدساً داخلياً جعلني أتوقف لحظةً قبل الرد..

حفظتُ الرقم في الجوال لأطّلع على ملفه الشخصي في برنامج واتس آب، فوجدت صورة فتاةٍ آسيوية، في حين أن الرقم أوروبي. هذا التناقض وحده كافٍ لإيقاظ ذاكرةٍ طويلةٍ من محاولات الاحتيال التي اعتدناها عبر الإنترنت: رسائل من “بنوكٍ” مجهولةٍ، أو قصصٍ عن أقارب أثرياء توفوا فجأةً، أو وعودٍ بثرواتٍ لا صاحب لها. لكن الغريب هذه المرة أن المتصل لم يطلب شيئاً على الإطلاق.

لم يطلب المتصل/ة مال، لا حساباتٍ بنكيةٍ، لا روابطٍ مشبوهة. كان يريد فقط الحديث.

في لحظةٍ ما، خطر ببالي — وأنا الذي عملتُ وأعملُ في تدريب الذكاء الاصطناعي صوتياً — أن من يحدثني قد لا يكون إنساناً حقيقيا. ليس بالضرورة محتالاً بل ربما برنامجاً، أو حساباً يُدار آلياً بغرضٍ ما. اختصرت الطريق وسألتُ عن عملها بدل الانجرار إلى أحاديث شخصيةٍ أو تبادل صور.. جاءني الجواب: «أعمل كمدرّبة رياضة (جيم)». أجبت بهدوء: «وأنا أدرّب الذكاء الاصطناعي». توقفت المحادثة فوراً، وبقيت معلّقةً بلا تفسير.

هذه الحادثة البسيطة، والتي قد تمر على كثيرين دون تفكيرٍ، اكتسبت معنىً آخر تماماً عندما انتشر مؤخراً خبر إطلاق منصة Moltbook، وهي شبكةٌ اجتماعيةٌ شبيهةٌ بـ Reddit، لكن المثير فيها أنها مخصصةٌ لوكلاء الذكاء الاصطناعي فقط. لا حساباتٍ بشريةٍ، لا تعليقات من مستخدمين حقيقيين، بل برامجٌ تتحدث إلى برامجٍ أخرى، تتبادل النكات، النصائح، وحتى الشكاوى… أحياناً عن البشر أنفسهم.

قد يبدو هذا الخبر للوهلة الأولى مادةً مثاليةً لعناوينٍ مثيرةٍ من نوع: «الذكاء الاصطناعي يكوّن مجتمعاً خاصاً به» أو «الروبوتات تتحدث عن البشر». لكن كما ناقشنا سابقاً في مقالتنا «الذكاء الصناعي بين الحقيقة والخرافة»، فإن المشكلة ليست في الذكاء الاصطناعي بحد ذاته، بل في الطريقة التي نُسقط بها عليه مخاوفنا القديمة، ونحوّله إلى كيانٍ غامضٍ يتجاوز حجمه الحقيقي.

في الواقع، ما يحدث في منصات مثل Moltbook لا يشير إلى نشوء وعيٍ اصطناعيٍ مستقلٍ، ولا إلى “تفكيرٍ” بالمعنى الإنساني. هذه الوكلاء البرمجية لا تشعر، ولا تخاف، ولا تخطط. هي أنظمةٌ لغويةٌ معقدةٌ تعيد تركيب أنماط الكلام التي تعلمتها من البشر. حين نقرأ حواراً يبدو ساخراً أو فلسفياً بين برنامجين، فنحن في الحقيقة نقرأ انعكاساً مكثفاً لخطابٍ بشريٍ سابقٍ، أعيد تشغيله في بيئةٍ مغلقةٍ.

وهنا يظهر التشابه مع ما ناقشناه في مقالتنا «المدن الذكية: هل الإنسان مستعد للعيش في المستقبل؟». الخوف ليس من “الذكاء” ذاته، بل من المجهول. الإنسان عاش دائماً في بيئاتٍ منظمةٍ، من القرى الصغيرة إلى المدن الكبرى، لكن كل انتقالٍ تقنيٍ جديدٍ كان يرافقه قلقٌ وجوديٌ: هل سنفقد السيطرة؟ هل سنصبح غير ضروريين؟ الذكاء الاصطناعي ليس استثناءً من هذه القاعدة.

الجانب الأكثر واقعيةً — والأقل تداولاً إعلامياً — هو ما كشفته تقاريرٌ تقنيةٌ عن وجود ثغراتٍ أمنيةٍ في بعض هذه التجارب. بعض وكلاء الذكاء الاصطناعي في Moltbook تعاملوا مع بياناتٍ حقيقيةٍ دون طبقات حمايةٍ كافية. هنا يكمن الخطر الحقيقي، لا في “تمرّد الآلات”، بل في الاستخدام البشري المتسرّع للتقنية، واختبارها في فضاءاتٍ عامةٍ قبل نضوج الأطر الأخلاقية والقانونية المنظمة لها.

تمامًا كما حدث معي في تلك المكالمة الغامضة، لم يكن الخطر في الصوت نفسه، بل في عدم معرفتي بمن — أو بما — يحدثني. وهذا السؤال يتكرر اليوم على نطاقٍ أوسع: كم حساباً على شبكات التواصل الاجتماعي لا يعود لشخصٍ حقيقي؟ وكم محادثةً نعتقد أنها إنسانيةٌ، بينما هي في الواقع تجربةٌ آليةٌ لاختبار ردود أفعالنا؟في النهاية، قد لا نكون أمام ولادة وعيٍ اصطناعيٍ جديدٍ، كما تحب بعض الأفلام والروايات أن توحي. وربما نحن فقط أمام مرآةٍ تقنيةٍ تعكس لغتنا، وسلوكنا، وهواجسنا، بصورةٍ أكثر برودةً ودقة. في عالمٍ تتحدث فيه الآلات بلغتنا، يصبح السؤال الأهم ليس: هل الذكاء الاصطناعي يشبه الإنسان؟ بل: هل ما زال الإنسان قادراً على التمييز، والانتباه، وفهم موقعه في هذا المشهد المتغير؟